Im Online-Marketing müssen wir immer mehr Daten analysieren und interpretieren. Für meine Arbeit habe ich daher einige grundlegende Erkenntnisse gezogen. Diese möchte ich in diesem Beitrag mit euch teilen.

Inhaltsverzeichnis

Sich auf eine einzige Kennzahl festlegen

Die Gesamtheit sagt noch nichts über Einzelheiten aus

Vergleiche ich Daten aus derselben Quelle?

Sind die Daten vollständig?

Rahmenbedingungen beachten

Betrachte ich wirklich alle Daten?

Abweichungen erkennen

Datenanalyse auswerten

In unserem Alltag haben wir es zunehmend mit mehr Statistiken zu tun. Sei es die Bewertung der Ads-Kampagnen oder die Datenanalyse mit Google Analytics. All diese Daten müssen wir analysieren und interpretieren. Bei meiner Arbeit fielen mir einige grundlegende Erkenntnisse auf.

Sich auf eine einzige Kennzahl festlegen

In den seltensten Fällen reicht eine Kennzahl aus, um die richtigen Rückschlüsse zu ziehen. Wenn es z.B. heißt: “Es wurden 1,5 Mio. Impressionen erzielt”, dann klingt erstmal beeindruckend. Aber wenn die Klickrate nur im unteren einstelligen Bereich liegt, so nützen die vielen Impressionen herzlich wenig. Anderes Bsp.; mir ist es schon passiert, dass ich annahm den Hauptfehler für schlechte Rankings gefunden zu haben. Tatsächlich aber war dies nur ein Einzelfall. Im vergleich mit anderen Daten fiel dann auf, dass es nur bei einer URL auftrat. Ich habe geglaubt, dass dies für die gesamte Webseite zutrifft. Ich hatte mir ausgerechnet den Wert herausgepickt, welcher schlecht performt. Aber in etlichen anderen Fällen stellte sich dies als falsch heraus.

Fazit: Selten reicht eine Kennzahl aus, um eine Aussage zu machen. Von daher würde immer mehrere Werte miteinander vergleichen und diese in Relation zu einander setzen. Es kann passieren, dass man beim Vergleich ausgerechnet den Wert erwischt, wovon man glaubt, dass dieser der Grund für das Problem darstellt. Doch beim Vergleich stellt sich dies nur als Sonderfall heraus.

Die Gesamtheit sagt noch nichts über Einzelheiten aus

Die 2. Erkenntnis baut auf der ersten auf. Um festzustellen, wie sich die Webseite im Laufe der Zeit entwickelt, schaut ihr regelmäßig auf die Sichtbarkeit. Dazu nutzt ihr z.B. den OVI-Wert. Je höher dieser ist, desto besser. Steigt dieser also, so sind wahrscheinlich auch immer mehr top Rankings dabei. Doch in Wahrheit werden in diese Kennzahl auch branchenfremde Keywords mit hineingerechnet. Diese verwässern den OVI und machen eine Gesamtaussage daher schwieriger. Denn einige wenige top Rankings für womöglich noch nicht einmal relevanten Keywords, bringen euch herzlich wenig, wenn die top Keywords schlecht performen. Im besten Fall lässt der OVI also allenfalls eine pauschale Beurteilung zu – mehr jedoch nicht.

Fazit: Die Gesamtheit sagt erstmal nur etwas grundsätzliches aus – nicht aber über Einzelheiten. Diese können wiederum komplett anders ausfallen. Deshalb solltet ihr solche Mischwerte immer näher analysieren. Hinterfragt sie: Wie werden diese berechnet? Nur so lassen sich bessere Rückschlüsse ziehen. Xovi z.B. setzt aus diesem Grund den Monitoring-OVI ein. Dieser bezieht sich auf die gewünschten Keywords, die ihr festlegt.

Vergleiche ich Daten aus derselben Quelle?

Mein Beitrag Google for Jobs hat im Site Kit eine Absprungrate von 100%. Dagegen liegt die Absprungrate in Google Analytics 4 nur bei 39%. Wie kommt das zustande? Der Grund für die Abweichung ist u.a., dass das Site Kit seine Daten aus einer UA-Property bezieht. Beide Angaben stammen also aus 2 unterschiedlichen Datenquellen. Ein anderer Grund ist, dass bei beiden Tools ein anderes Datenmodell zugrunde liegt. Die Berechnung erfolgt somit auf einer anderen Grundlage. Ähnlich verhält es sich, wenn ihr die Domain Authority prüfen wollt. Jedes Tool berechnet den Wert anders. Dadurch ergeben sich zwangsläufig Abweichungen.

Fazit: Bei all den Daten müssen wir uns immer wieder bewusst machen, aus welcher Quelle sie stammen: nämlich von Google. Im Online-Marketing haben wir keine Vergleichsdaten einer ähnlichen Suchmaschine. Wir müssen uns zwangsläufig darauf verlassen, welche Zahlen wir vom Betreiber bekommen. Und diese können voneinander abweichen. Was helfen kann ist, Vergleichstool zu installieren, z.B. Matomo. Eine andere Möglichkeit ist, die Rohdaten anzusehen. Dies ist mit BigQuery möglich. Was auch hilft sind Referenzwerte aus ähnlichen Quellen. Wobei man auch hier wieder die Stärken und Schwächen der Tools kennen muss.

Sind die Daten vollständig?

Oftmals schauen wir in Google Analytics und glauben zunächst, dass alles soweit stimmt. Doch das was dort dargestellt wird, hängt von vielen Faktoren ab. Werden z.B. die internen Zugriffe und die Referrals ausgeschlossen? In Universal Analytics haben wir es oftmals mit dem Sampling (Stichprobe) zu tun. D.h. wir sehen nur einen Teil der Daten. Ähnlich GA4: sind nicht genügend Daten vorhanden, wird die Grenzfunktion angewandt. Womöglich vergleiche ich dann nur Teilbereiche. Mit der Frage: Wie genau ist Google Analytics habe ich mich bereits in einem anderen Beitrag beschäftigt. Wichtig ist auch zu wissen, dass die Daten von Google vorab gefiltert werden. In der Search Console sehen wir unter den Suchbegriffen nur einen Auszug. Was auch in Ordnung ist. Denn wenn ein Nutzer in die Suche etwas sehr persönliches eingibt, dann sollte dies als Keyword nicht in der Search Console auftauchen.

Rahmenbedingungen beachten

Die Daten unterliegen oftmals inneren Faktoren und äußeren Faktoren. Einerseits sind die Werte davon abhängig, wie sie erhoben oder berechnet werden. Wie schon gesagt, können die Werte hierbei verwässern. Auf der anderen Seite gibt es immer auch äußere Einflüsse, die berücksichtigt werden müssen. Es kann sein, dass Google Analytics unabsichtlich doppelt in die Webseite eingebaut wurde. Ein anderes Bsp. ist das Thema PageSpeed. Die Ladegeschwindigkeit ist einerseits von internen Faktoren geprägt, z.B. von den Bildgrößen oder die Anzahl der Scripte. Andererseits kann es auch am Server liegen. Ist dieser nicht besonders leistungsstark, dafür die Ladegeschwindigkeit der Webseite aber optimiert, dann können ebenso schlechte Werte das Ergebnis sein.

Betrachte ich wirklich alle Daten?

Auch diese Erkenntnis schließt sich an die vorherige an. Für die Beurteilung der Performance einer Landingpage z.B. muss ich mir alle Daten dazu einholen: Seitenansichten, Verweildauer, Events etc. Doch reichen diese schon aus, um Rückschlüsse zu ziehen? Zwar erhebt Google Analytics 4 schon im Standard allerhand Daten, doch sind zum Teil ungenau. So z.B. die Scrolltiefe. Dennoch kann es für die Kampagnenplanung ratsam sein, ein erweitertes Tracking einzurichten. Wurde z.B. das Video abgespielt? Welche Buttons wurden angeklickt? etc. Anderes Bsp.: Wenn ihr Google Trends nutzt solltet ihr darauf achten, dass hier keine absoluten Zahlen dargestellt werden. Es sind bestenfalls Tendenzen.

Fazit: Alles, was mir Google Analytics anzeigt, kann nur ein Ausschnitt sein. Das muss ich für eine Beurteilung wissen. Eine andere Frage ist: Brauche ich ggfs. ein erweitertes Tracking um die richtigen Rückschlüsse zu ziehen? Ich muss verstehen, wie all diese Daten erhoben werden und wodurch Abweichungen entstehen können.

Abweichungen erkennen

Habe ich die vorherigen Dinge beachtet, kann ich anfangen die Daten zu beurteilen. Fallen euch auf Anhieb Abweichungen (Anomalien) auf? Gibt es Ausschläge in der Grafik? Tritt das Muster in regelmäßigen Abständen auf? Vergleiche ich die Daten desselben Zeitraums? Wie ist die Entwicklung über einen längeren Zeitraum? Ist ein Wert zu tief oder zu hoch? All diese Fragen können helfen, Abweichungen zu finden. Übrigens: Google informiert über Abweichungen in der Search Console auf dieser Seite.

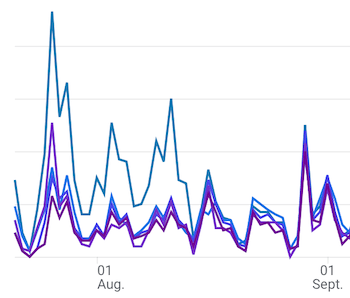

Dazu ein Bsp.. In der folgenden Grafik (blaue Ausschläge) geht es um ein Event-Tracking. Im Zeitraum um den 1. August findet sich eine deutliche Abweichung.

Abweichung in den Daten erkennen.

Eine nähere Betrachtung zeigt, dass der Ausschlag auf das Event page_view zurückzuführen ist. Dagegen blieben die anderen Zahlen, z.B. vom Event Engagement weitesgehend gleich. Erklärung: In dieser Zeit wurden mehr Direktaufrufe verzeichnet, als über die organische Suche. Diese riefen etwas häufiger als sonst die Startseite auf und verließen sie anschließend wieder – ohne weitere Interaktion. Da beim Aufruf der Startseite der zuletzt veröffentlichte Beitrag ganz oben steht, lag es wohl daran, dass dieser nicht interessant war.

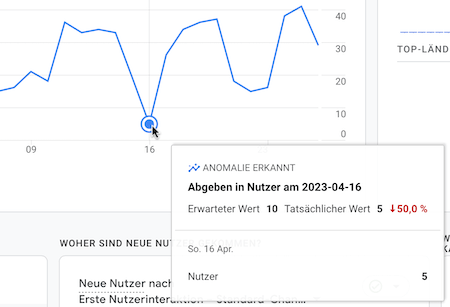

Anomalie in GA4.

Weiteres Bsp.: Auch wenn in Google Analytics 4 Abweichungen feststellt, werden diese dargestellt.

Fazit: Bei der Betrachtung der Daten sollte zunächst auf das Ganze geschaut werden. Danach solltet ihr auf Abweichungen achten und diese weiter analysieren. Wenn ihr über die Daten nur sehr wenig in Erfahrung bringen könnt, holt euch Unterstützung.

Datenanalyse auswerten

Bei einer Datenanalyse hat sich im Laufe der Zeit eine Herangehensweisen bewährt. Zunächst bereite ich die Daten grafisch auf. Dann gehe ich erst auf die Gesamtheit ein, bevor ich mir die Teilbereiche ansehen. Diese analysiere ich weiter und gehe den Ursachen auf den Grund. Dabei picke ich mir Einzelheiten und Abweichungen heraus. Im Anschluss fasse ich die Erkenntnisse kurz zusammen. Bei größeren Datenanalysen hilft auch eine kurze Zusammenfassung der Ergebnisse des Teilbereichs. Danach betrachte ich den nächsten Teilbereich. Auch hier gehe ich wie beschrieben vor. Zum Schluss fasse ich die gewonnenen Erkenntnisse insgesamt zusammen.

Abschließend muss ich noch sagen, dass sich Zahlen und Daten oftmals unterschiedlich interpretieren lassen. Jeder legt die Zahlen anders aus. Das ist keine böse Absicht oder eine Unterstellung, sondern einfach eine andere Betrachtungsweise. Bei Zweifeln: Eine 2. Meinung einholen.